Разговор об искусственном интеллекте и искусстве обычно мечется между двумя крайностями: либо бесконечный поток безвкусного «AI-мусора», либо полная автоматизация, где человек остаётся не у дел. Но самый желанный сценарий — когда ИИ становится полезным партнёром. Пока же художники, работающие с текстом в генераторах картинок, сталкиваются с элементарными проблемами: попросить «дом» — легко, а заставить нейросеть нарисовать именно красный дом с четырьмя окнами спереди, трубой и плющом слева — это уже лотерея.

Учёные из Стэнфорда — специалисты по информатике, когнитивной психологии и образованию — уверены, что решение есть. Они создают общий «концептуальный язык», на котором человек и ИИ смогут понимать друг друга при создании качественного визуального контента: от иллюстраций и диаграмм до анимаций.

«Модели выглядят потрясающе, но как партнёры они ужасны, — говорит Маниш Агравала (Maneesh Agrawala), профессор информатики Стэнфорда и один из руководителей проекта. — Автор не может предсказать, что именно выдаст ИИ по промпту. Попросишь обычный пригородный дом — получишь современный дуплекс».

По словам Агравалы, создание оригинального контента требует постоянных мнений и выборов. Значит, человеку и ИИ нужно общее понимание понятий, чтобы нюансы не терялись при «переводе».

Как люди договариваются в творчестве

Команда Стэнфорда идёт сразу двумя путями. Первый — глубокое изучение человеческого процесса. Учёные проводят эксперименты: люди вместе создают визуальный контент, а исследователи анализируют чат-логи и наброски, чтобы понять, как участники устанавливают общий язык.

«Если мы хотим, чтобы ИИ понимал, как думает человек во время творчества, нужно сначала максимально изучить, как люди сами находят общий концептуальный грунт, — объясняет Джудит Фан (Judith Fan), доцент психологии Стэнфорда. — Не все говорят и рисуют одинаково, но все ожидают, что их поймут».

Инструменты, которые уже работают

Второй путь — практические открытые инструменты, которые переносят эти уроки в реальность.

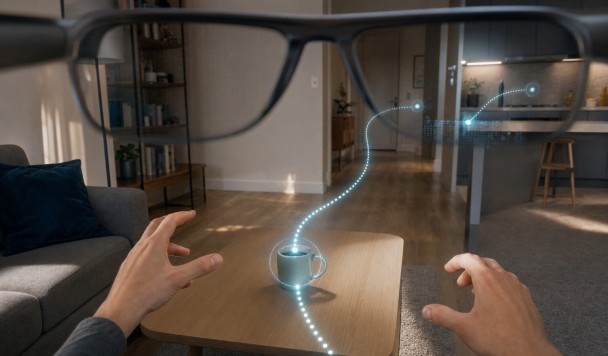

ControlNet учит диффузионные модели понимать пространственную композицию. Он делит процесс на два этапа — грубый набросок и детализация, — точно как художник. Теперь создатели могут задавать позу или расположение объектов, а не надеяться на удачу.

FramePack позволяет генерировать 3D-видео из текстового описания для многосценарного повествования. ИИ учится расставлять приоритеты сцен по важности для истории — как это делает человек.

Третий инструмент использует нейро-символический ИИ: нейросети соединяются с логическим мышлением, чтобы модель перестала быть «чёрным ящиком». Из обычного текста рождается код, который строит 3D-сцену. Художник в любой момент может посмотреть код, отредактировать его и попросить ИИ переделать.

От игр до образования

Общий язык между человеком и ИИ уже открывает двери в дизайн, симуляции, анимацию, робототехнику и образование. Сейчас команда работает с платформой Roblox: игроки смогут создавать уникальные 3D-объекты по тексту, но с учётом игровых ограничений (например, в мирном проекте оружие не появится).

В перспективе любой человек — от хоббииста и владельца малого бизнеса до профессионального художника — сможет легко выражать идеи, комбинируя естественный язык, примеры, кусочки кода и другие способы.

«Мы серьёзно настроены дать всей творческой аудитории инструменты, чтобы эффективно общаться с ИИ», — подчёркивает Джудит Фан.