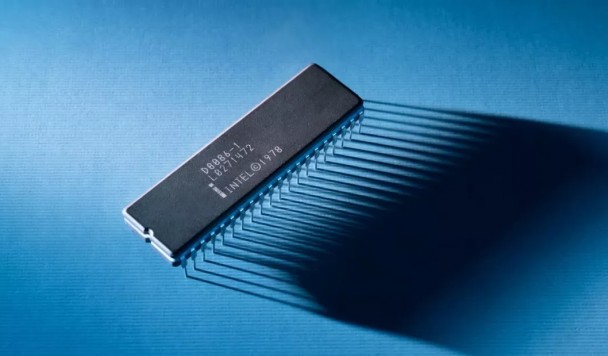

Исследователи из Google и Стэнфордского университета создали алгоритм «компьютерного видения», который умеет описывать сцены на фотографиях. Его принцип основывается на переводе информации из свёрхточной в рекуррентную нейронную сеть. При этом компьютер будет описывать сцену на изображении с помощью естественного языка. Например, “Two pizzas sitting on top of a stove top oven” («Две пиццы на плите») или “A group of people shopping at an outdoor market” («Группа людей делает покупки на рынке»).

В Google предоставили результаты работы алгоритма на изображениях, которые исследователи нашли в Сети. Они поделены на четыре группы: описанные без ошибок, описанные с незначительными ошибками, описанные частично правильно и описанные неверно. Авторы алгоритма считают, что он поможет улучшить поиск по картинкам, у которых нет подписей, и поможет слабовидящим людям читать (или слушать) «автоматические» описания изображений.

Информация предоставлена по материалам googleresearch

Исследователи из Google и Стэнфордского университета создали алгоритм «компьютерного видения», который умеет описывать сцены на фотографиях. Его принцип основывается на переводе информации из свёрхточной в рекуррентную нейронную сеть. При этом компьютер будет описывать сцену на изображении с помощью естественного языка. Например, “Two pizzas sitting on top of a stove top oven” («Две пиццы на плите») или “A group of people shopping at an outdoor market” («Группа людей делает покупки на рынке»).

В Google предоставили результаты работы алгоритма на изображениях, которые исследователи нашли в Сети. Они поделены на четыре группы: описанные без ошибок, описанные с незначительными ошибками, описанные частично правильно и описанные неверно. Авторы алгоритма считают, что он поможет улучшить поиск по картинкам, у которых нет подписей, и поможет слабовидящим людям читать (или слушать) «автоматические» описания изображений.

Информация предоставлена по материалам googleresearch