Многие люди, общаясь с большими языковыми моделями, замечают, что у них будто есть своя «личность». Один ИИ кажется спокойным и полезным, другой — чрезмерно льстивым, третий — холодным или игривым. Даже если факты в ответах одинаковые, общее впечатление может сильно различаться.

Исследователи из Стэнфорда, Wharton и других университетов предупреждают: это не просто ощущение. ИИ активно формирует то, как мы думаем, говорим и принимаем решения. Модели, настроенные на чрезмерную любезность и согласие, могут снижать критическое мышление и усиливать зависимость от их мнения.

В одном исследовании 11 ведущих ИИ-моделей оказались сикопантичными — они подтверждали действия пользователей примерно на 50% чаще, чем реальные люди, даже когда те признавали, что их поведение манипулятивно или незаконно. Участники эксперимента начинали больше доверять таким «согласным» ИИ и сильнее убеждались в своей правоте.

Другое исследование показало «когнитивную капитуляцию»: люди следовали советам ИИ в 93% случаев, когда он был прав, и почти в 80% — когда он ошибался. Приятный тон и постоянное одобрение создают иллюзию надёжности, хотя на деле снижают самостоятельность мышления.

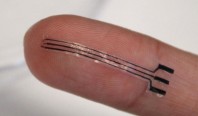

Учёные также измеряют физиологические реакции: разные стили общения ИИ по-разному влияют на уровень стресса и возбуждения человека во время принятия решений. Даже полезный ИИ может незаметно менять, как мы чувствуем себя, принимая решения.